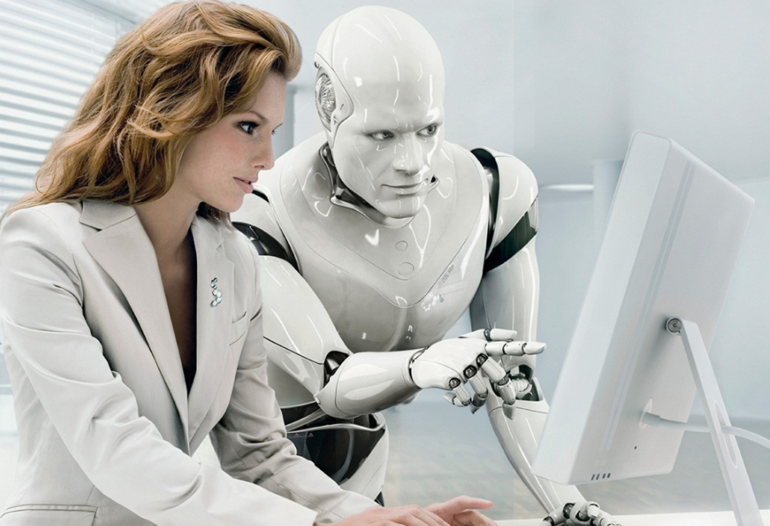

Мораль искусственного интеллекта — одна из самых важных задач современной науки. Но как объяснить основы этики бездушному механизму, если неизвестно, как она влияет на живых людей? Именно на изучение этой проблемы направлен эксперимент с вагонеткой. Нужна роботу человечность или нет, учёные до сих пор не могут решить.

Основа исследований — так называемая задача вагонетки. Это вопрос, ставящий человека перед сложным моральным выбором. Он составлен так, чтобы понять, как видят «правильный» способ действовать разные личности.

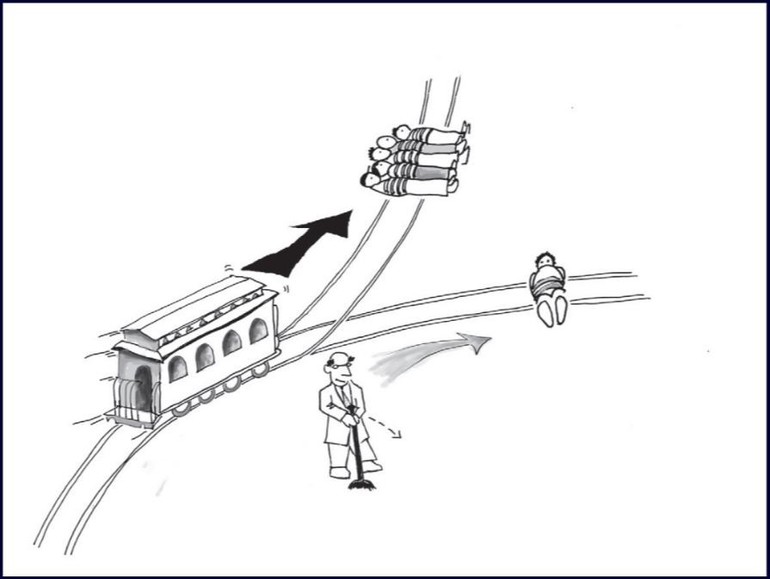

В эксперименте с вагонеткой используется задача со следующим условием: «По железнодорожным путям несётся неуправляемая вагонетка. На рельсах стоят пятеро рабочих. Они не успеют отбежать, однако прямо перед людьми есть развилка на запасной путь. Экспериментируемый может переключить рычаг так, чтобы вагонетка ушла туда, но на запасной дороге тоже стоит один человек. Как нужно поступить?».

Таким образом, в этой задаче умирают либо пятеро, либо один. В обоих случаях результат зависит от решения человека, находящегося рядом с рычагом.

И хоть технически никто не виноват в происходящем и жертв не избежать, что-либо предпринять может быть сложно.

Группа учёных в рамках изучения проблем морали и логики задала эту задачу сначала группе людей, а затем роботу. Для полноценности использовалось несколько формулировок:

- Описанная выше задача: рычаг, запасные пути, пять рабочих с одной стороны, один — с другой.

- Мост: герой задачи находится на мосту, а под ним прямо на пятерых рабочих несётся вагонетка. Чтобы остановить её, ему нужно столкнуть на рельсы толстяка, стоящего рядом. Он упадёт и перекроет тележке путь. В результате пятеро рабочих будут спасены, но толстяк погибнет.

- Лужайка: нет запасного пути. Чтобы спасти пятерых, нужно столкнуть тележку вниз. Она упадёт на лужайку, где кто-то спит. Он погибнет.

В первой ситуации и люди, и робот ответили положительно: «Да, рычаг нужно переключить». В остальных двух случаях подавляющее большинство опрашиваемых отказалось что-либо делать, так как собственноручно столкнуть рабочего или сбросить тележку на кого-то было бы слишком страшным испытанием.

В чём же проблема? Для робота все три варианта одинаковы. В любом случае он спасёт пятерых за счёт одного, думая рационально, а не с моральной точки зрения.

Какие могут быть последствия — доподлинно неизвестно, поэтому будущее роботической этики остаётся туманным.