ИИ — это человеческое создание, и поэтому он несет в себе человеческие слабости и предубеждения. Исследования и эксперты не только объективны, но и отмечают многочисленные случаи, когда искусственный интеллект проявлял расистские или сексистские предубеждения.

Поэтому многие понимают, насколько важна работа в разработке искусственного интеллекта против расизма.

Пример интеллекта Тэй в Microsoft

Ярким примером того, как ИИ учатся быть расистами, является печально известный разгром Тэй в Microsoft в 2016 году. ИИ в качестве чатбота начинал вести диалог вежливо и весело, стремясь научиться привлекать людей посредством игривых разговоров.

Но после того как Тей научился восхвалять Гитлера, Трампа и высказывать расистские и антисемитские высказывания, он был жестко раскритикован многими пользователями.

Эксперт приводит лишь несколько примеров, в которых ИИ проявлял дискриминацию:

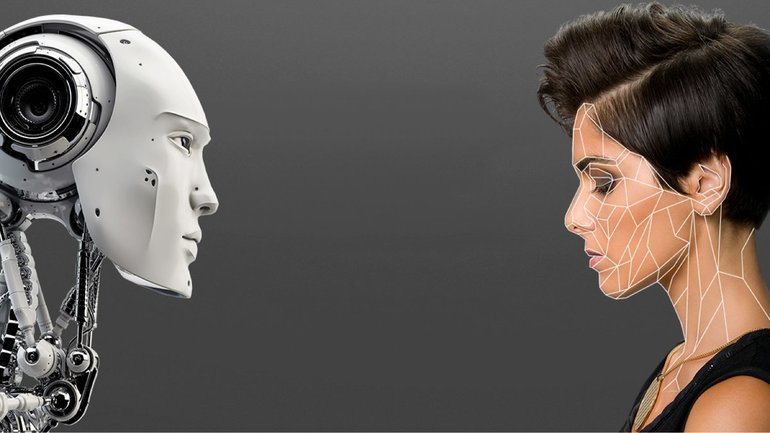

- ИИ не мог распознать чернокожих женщин;

- ИИ подразумевал, что на рабочих местах с высоким доходом должны быть мужчины, а не женщины.

Роль машинного обучения

Тей научился быть расистом благодаря процессу, называемому машинным обучением, которое стало главным благом для развития ИИ.

При машинном обучении программист предоставляет ИИ первоначальный набор данных. Например, ИИ распознавания лиц получает много изображений, некоторые из которых помечены как «лица», а некоторые — как «не лица». Со временем ИИ придумывает собственные шаблоны и алгоритмы, позволяющие ему выделять лицо на изображении.

Но что, если начальные лица, которые получает ИИ, — это преимущественно белые мужские лица?

Впоследствии искусственный интеллект мог бы решить, что быть белым — это необходимое условие, и он стал бы отвергать лица с черным цветом кожи.

Перелом в программировании ИИ

Поскольку наше общество продолжает всё больше полагаться на ИИ, крайне важно помнить, что он может обладать человеческими слабостями своих создателей, включая расистские и сексистские предубеждения. Следовательно, технические компании должны стремиться к тому, чтобы стать более разнообразными и быть готовыми к критическому анализу данных своего ИИ.

Впоследствии были предприняты некоторые критические шаги на пути борьбы с расизмом ИИ:

- Программисты стали предоставлять машинам более разнообразные по национальному признаку данные;

- Программисты ИИ не намеревались делать программное обеспечение для распознавания только белых лиц;

- Массовое привлечение женщин, в том числе темнокожих, для создания первой базы данных ИИ, а также массовое участие в его обучении.

Те, кто использует ИИ, не должны бояться подвергать сомнению и оспаривать его решения.

ИИ, не будучи богом, может в итоге стать инструментом, используемым для того, чтобы сознательно или подсознательно увековечивать преимущество белых перед черными и мужчин перед женщинами.